广州技术支持 骏域网站建设招工网站58同城

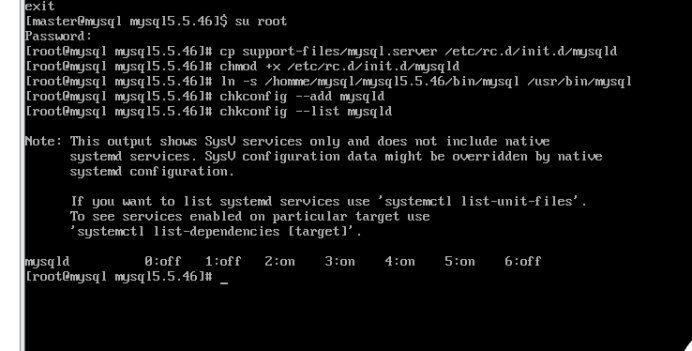

广州技术支持 骏域网站建设,招工网站58同城,江西省赣州市中考分数线2021,如何推广app赚钱文章目录前言一、环境要求二、环境准备1.虚拟机的安装2.配置静态 IP#xff08;1#xff09;使用命令#xff08;2#xff09;打开配置文件#xff1a;按 i 键, 进入编辑模式#xff0c;修改如下配置#xff1a;#xff08;3#xff09;完成以上修改后#xff0c;按 …文章目录前言一、环境要求二、环境准备1.虚拟机的安装2.配置静态 IP1使用命令2打开配置文件按 i 键, 进入编辑模式修改如下配置3完成以上修改后按 Esc 退出编辑模式输入 :wq , 保存退出网络配置文件4配置完成后 重启网络 命令5输入 ifconfig 或者 ip a, 查看网络。6测试连接输入 ping 192.168.xxx.xxx,或者 ping www.baidu.com 查看网络连接。3.文件上传下载工具winScp的安装配置4.jdk的安装配置1将jdk压缩包从Windows传到虚拟机上拖拽即可传输2cd到存放jdk压缩包的目录进行解压缩到指定位置3配置jdk环境变量4将本台机器jdk的安装配置复制到另外两台机器上5.免密登录同一机器不同用户之间免密登录1双方都生成密钥2 切换到 root 用户互相添加公钥3设置正确的权限4测试免密登录同一用户不同机器之间免密登录1)配置 /etc/hosts(2)创建 master 用户如未创建(3)成 master 用户 SSH 密钥(4)分发公钥到其他主机用主机名 (4)测试免密登录用主机名三.Hadoop搭建1.关闭防火墙2.使用winscp将Windows上面的压缩包传到Linux上3.配置环境变量4.修改hadoop配置文件1编辑hadoop-env.sh2编辑core-site.xml3编辑hdfs-site.xml4编辑mapred-site.xml5编辑yarn-site.xml6编辑slaves7修改Hadoop的配置文件-同步配置到其他机器5.格式化并启动6.验证Hadoop服务验证Hadoop服务 hdfs dfsadmin –report命令验证Hadoop服务-jps命令验证Hadoop服务-网页端NameNode 界面ResourceManager 界面若启动 YARN7.停止Hadoop服务四.Hive安装1.安装前的准备1服务器基础环境正常2Hadoop集群健康可用3hadoop与hive整合(适合hadoop3.x和hive3.x以上)2.内嵌模式1上传解压Hive安装包2配置hive环境变量3修改hive配置文件4创建Hive工作目录5初始化元数据数据库6启动Hive3.本地模式1删除centos7自带Mariadb2安装mysql3编辑/etc/my.cnf4新增mysql分组、组用户mysql及mysql安装目录的拥有者5安装mysql6mysql额外配置7mysql配置8配置mysql环境变量9启动mysql并设置root用户密码10登录mysql进行验证11在mysql下创建hive数据库12授权远程机器访问hive数据库13上传mysql驱动到hive的bin目录14复制hive的jline2.12.jar到hadoop相应目录15修改hive-site.xml16初始化元数据17启动hive4.远程模式1配置hive-site.xml2初始化元数据3启动hive前言本文详细介绍了如何在CentOS7系统安装和配置Hive以及前期的准备虚拟机jdk文件上传下载工具的安装配置以及免密登录的实现hadoop的安装配置。一、环境要求在一个典型的大数据集群中三台机器分别承担不同角色并协同工作。主节点Master是核心管理节点负责资源调度和任务分配运行 NameNode 和 ResourceManager 服务以管理 HDFS 元数据和 YARN 资源调度。主节点需要安装 JDK 1.7如 、Hadoop 2.6.0 Hive 1.2.0用于运行 CLI 或元存储服务。数据节点Slave01负责存储 HDFS 的数据块和执行计算任务运行 DataNode 和 NodeManager 服务需要安装 JDK 1.7 和 Hadoop 2.6.0并配置数据存储目录和资源限制。第三台机器用于安装 MySQL 5.5.56MySQL 作为 Hive 的元存储Metastore保存表结构和分区信息。MySQL 的 数据库需创建并通过配置 Hive 的 文件连接 MySQL同时安装 MySQL JDBC 驱动到 Hive 的 目录中。三者通过 HDFS、YARN 和 MySQL 协同工作Master 管理文件系统的元数据和资源调度Slave01 存储数据块并执行任务MySQL 保存 Hive 的元数据Hive 通过 SQL 查询访问 HDFS 上的数据实现完整的大数据处理流程。二、环境准备我们需要按照如下步骤装三台虚拟机为后期集群准备分别命名为hivemasterhiveslave01和mysql同一个用户为master。1.虚拟机的安装步骤如下示例配置 /etc/hosts在三台机器的 文件都加上三台虚拟机的 IP 和主机名。 例如/etc/hosts192.168.128.148 hivemaster 192.168.128.149 hiveslave01 192.168.128.150 mysql这样你后续 ssh 可以用主机名比如ssh masterihveslave01 ssh mastermysql ssh masterhivemaster注意 每台虚拟机都要配置且内容一致(2)创建 master 用户如未创建在三台虚拟机分别执行sudo useradd master sudo passwd master(3)成 master 用户 SSH 密钥任选一台机器比如 hivemaster切换到 master 用户su-master ssh-keygen-t rsa-b 4096-Cmasterhivemaster一路回车不设密码(4)分发公钥到其他主机用主机名 在 hivemaster 上ssh-copy-idmasterhiveslave01 ssh-copy-idmastermysql在 hiveslave01 上同理su-master ssh-keygen-t rsa-b 4096-Cmasterhiveslave01ssh-copy-idmasterhivemaster ssh-copy-idmastermysql在 mysql 上同理su-master ssh-keygen-t rsa-b 4096-Cmastermysqlssh-copy-idmasterhivemaster ssh-copy-idmasterhiveslave01(4)测试免密登录用主机名在任意一台机器ssh masterhiveslave01 ssh mastermysql ssh masterhivemaster无需输入密码即可以登录。三.Hadoop搭建1.关闭防火墙防火墙可能拦截 Hadoop 节点间通信如 NameNode 与 DataNode 交换数据块信息。登录root用户使用systemctl status firewalld查看防火墙是否关闭如果这个地方是绿色的active表示防火墙是开启的需要使用systemctl stop firewalld 和systemctl disable firewalld 关闭防火墙。我下边这个是关闭着的。2.使用winscp将Windows上面的压缩包传到Linux上登录hadoop用户使用tar命令将Hadoop压缩包进行解压缩tar –zxvf hadoop-2.6.0-cdh5.7.6.tar.gz解压后进入到hadoop目录查看下是否上传成功。然后使用mv hadoop-2.6.0-cdh5.7.6 7.6hadoop2.6.0 对hadoop目录进行重命名便于记忆。3.配置环境变量登录root用户编辑/etc/profile文件配置hadoop的环境变量然后执行 source /etc/profile命令使hadoop环境变量配置立即生效最后输入 hadoop version(version前面没有-)验证hadoop环境变量是否配置成功出现hadoop版本号说明配置成功。HADOOP_HOME/home/master/hadoop/7.6hadoop2.6.0 PATH${HADOOP_HOME}/bin:$PATHexport HADOOP_HOME PATH4.修改hadoop配置文件1编辑hadoop-env.shvi/home/master/hadoop/7.6hadoop2.6.0/etc/hadoop/hadoop-env.sh这里的JAVA_HOME换成你自己的jdk路径2编辑core-site.xml上述命一样进入core-site.xml修改配置configuration property namefs.defaultFS/name valuehdfs://hivemaster:9000/value /property property nameio.file.buffer.size/name value4096/value /property property namehadoop.tmp.dir/name value/home/master/hadoop/data/tmp/value /property /configuration3编辑hdfs-site.xml编辑hdfs-site.xml配置hadoop hdfs的副本数量、主节点地址、secondary节点地址、块大小、允许web 页面访问等。configuration property namedfs.replication/name value2/value /property property namedfs.block.size/name value134217728/value /property property namedfs.namenode.name.dir/name value/home/master/hadoop/data/namenode/value /property property namedfs.datanode.data.dir/name value/home/master/hadoop/data/datanode/value /property property namedfs.http.address/name valuehivemaster:50070/value /property property namedfs.secondary.http.address/name valuehiveslave01:50090/value /property property namedfs.webhdfs.enabled/name valuetrue/value /property property namedfs.permission/name valuefalse/value /property /configuration4编辑mapred-site.xml编辑mapred-site.xml配置yarn资源调度器,我们这个版本没有mapred-site.xml只有mapred-site.xml.template所以需要把这个文件复制一份然后去掉后面的template。configuration property namemapreduce.framework.name/name valueyarn/value /property /configuration5编辑yarn-site.xml编辑yarn-site.xml指定yarn的resourcemanager、nodemanagerconfiguration property nameyarn.resourcemanager.hostname/name valuehivemaster/value /property property nameyarn.nodemanager.aux-services/name valuemapreduce_shuffle/value /property /configuration6编辑slaves7修改Hadoop的配置文件-同步配置到其他机器在hivemaster机器编辑完上述6个配置文件使用scp命令把hadoop目录分别复制到hiveslave01可选如果你还有另外一台hiveslave02机器。scp –r/home/master/hadoop/7.6hadoop2.6.0 masterhiveslave01:/home/master/hadoop可选 scp –r/home/master/hadoop/7.6hadoop2.6.0 masterhiveslave02:/home/master/hadoop登录hadoop用户执行下面命令使hadoop环境配置生效。source 7.6hadoop2.6.0/etc/hadoop/hadoop-env.sh5.格式化并启动在hivemaster机器登录master用户执行hadoop namenode –format格式化namenode节点只格式化1次。看到这个successfully formatted就表示格式化成功了。只有在格式化失败才需要重新格式化已经格式化成功的不需要再格式化。在在主节点(hivemaster)进入/home/hadoop/hadoop/hadoop2.6.0/sbin依次执行start-dfs.shstart-yarn.sh启动hadoop服务。6.验证Hadoop服务验证Hadoop服务hdfs dfsadmin –report命令验证Hadoop服务-jps命令验证Hadoop服务-网页端Hdfs网页地址http://namenode的主机ip:50070http://192.168.128.148:50070Yarn网页地址resourcemanager的主机ip:8088http://192.168.128.148:8088NameNode 界面地址http://192.168.128.148:50070此处需要换成你自己的ip地址端口可以不动ResourceManager 界面若启动 YARN地址http://192.168.128.128:80887.停止Hadoop服务在主节点进入/home/master/hadoop/7.6hadoop2.6.0/sbin目录依次执行stop-dfs.sh和stop-yarn.sh停止hadoop服务。四.Hive安装1.安装前的准备1服务器基础环境正常集群时间同步、防火墙关闭、主机与IP映射、免密登录、jdk安装配置2Hadoop集群健康可用启动hive前必须启动hadoop集群注意等hdfs安全模式关闭后再启动hive。hive不是分布式安装运行的软件其分布特性分布式存储和分布式计算由hadoop完成。3hadoop与hive整合(适合hadoop3.x和hive3.x以上)Hive 是数据仓库工具依赖 Hadoop 的 HDFS 来存储数据同时需要 Hadoop 的 MapReduce 或其他计算引擎如 Tez 或 Spark来执行查询。为了让 Hive 能在 Hadoop 集群中运行需要在 Hadoop 的配置文件中添加一些 Hive 所需的属性。2.内嵌模式1上传解压Hive安装包使用winscp上传Hive安装包apache-hive-1.2.0-bin.tar.gz使用tar –xzvf apache-hive-1.2.0-bin.tar.gz解压Hive安装包使用mv apache-hive-1.2.0-bin hive1.2.0对解压后的Hive文件夹进行重命名。2配置hive环境变量登录root用户在/etc/profile配置hive的全局环境变量并执行source /etc/profile命令 使配置立马生效HIVE_HOME/home/master/hive/hive1.2.0 PATH$PATH:${HIVE_HOME}/bin3修改hive配置文件修改地文件在hive根目录下conf目录下需修改hive-site.xml、hive-env.sh。修改前使用cp命令复制一份出来。由于hive1.2.0版本没有hive-site.xml我们自己使用vi 创建一个并进行编辑指定derby及metastore的存储位置property namejavax.jdo.option.ConnectionURL/name valuejdbc:derby:;databaseName$HIVE_HOME/metastore_db;createtrue/value /property property namehive.metastore.warehouse.dir/name value/home/master/hive/warehouse/value /property修改hive-env.sh指定hadoop及hive配置文件的存储位置4创建Hive工作目录为Hive创建工作目录前把hadoop集群启动hadoop fs-mkdir/tmp# 创建临时目录hadoop fs-mkdir-p/hive/warehouse# 创建 Hive 数据仓库目录hadoop fs-chmod gw/tmp# 为 /tmp 目录赋予用户组写权限hadoop fs-chmod gw/hive/warehouse# 为 /hive/warehouse 目录赋予用户组写权限5初始化元数据数据库执行schematool –initSchema –dbType derby初始化元数据数据库6启动Hive执行hive命令 启动Hive3.本地模式1删除centos7自带Mariadb# 1. 查询系统中是否已安装 MariaDB 相关的 RPM 包# 使用 rpm 命令列出所有安装的 RPM 软件包并通过 grep 过滤出包含 mariadb 的包名rpm-qa|grep mariadb# 如果上述命令输出了包含 mariadb 的包名例如mariadb-libs-5.5.44-2.e17.centos.X86_64# 说明 MariaDB 已安装在系统中需要卸载相关的包。# 2. 强制卸载 MariaDB 的库文件mariadb-libs# 使用 rpm 命令卸载 mariadb-libs 包忽略依赖关系# --nodeps 参数用于强制卸载即使其他软件依赖这个包也会无视依赖关系直接卸载rpm-e--nodeps mariadb-libs-5.5.44-2.e17.centos.X86_64# 注意强制卸载时需要小心可能会影响其他依赖 MariaDB 的软件或服务。# 3. 删除 MariaDB 的主配置文件# /etc/my.cnf 是 MariaDB 或 MySQL 的主配置文件执行以下命令强制删除该文件rm-f/etc/my.cnf# 4. 删除 MariaDB 的额外配置目录# /etc/my.cnf.d 是一个存储额外配置文件的目录递归删除该目录及其所有内容rm-rf/etc/my.cnf.d# 注意删除配置文件后MariaDB 或 MySQL 的相关配置将会失效。# 如果计划重新安装 MariaDB 或 MySQL请确保备份好这些配置文件以便后续恢复。2安装mysql使用winscp上传 mysql如下图。这里版本是mysql-5.5.46-linux2.6-x86_64.tar.gz。mysql下载地址选择相应版本https://downloads.mysql.com/archives/community使用tar –zxvf mysql-5.5.46-linux2.6-x86_64.tar.gz解压mysql安装包并使用mv mysql-5.5.46-linux2.6-x86_64 mysql5.5.46进行重命名便于记忆3编辑/etc/my.cnf使用vi /etc/my.cnf编辑mysql配置[mysql]default-character-setutf8 socket/home/mysql/mysql5.5.46/data/mysql.sock[mysqld]skip-name-resolve port3306 socket/home/mysql/mysql5.5.46/data/mysql.sock basedir/home/mysql/mysql5.5.46 datadir/home/mysql/mysql5.5.46/datamax_connections200 character-set-serverutf8 default-storage-engineINNODB lower_case_table_name1 max_allowed_packet16M4新增mysql分组、组用户mysql及mysql安装目录的拥有者# 1. 添加 MySQL 用户组# groupadd 命令用于创建一个新的用户组这里创建一个名为 mysql 的用户组groupadd mysql# 2. 添加 MySQL 用户并将其归属到 mysql 用户组中# useradd 命令用于创建一个新用户这里创建一个名为 mysql 的用户# -g mysql 表示将 mysql 用户加入到 mysql 用户组useradd-g mysql mysql# 3. 修改 MySQL 安装目录的拥有者为 mysql 用户和 mysql 用户组# chown 命令用于更改文件或目录的所有权# -R 表示递归更改即对目录及其所有子目录和文件都进行所有权修改# /home/mysql/mysql5.5.56 是 MySQL 的安装目录chown-R mysql:mysql/home/mysql/mysql5.5.56# 注释# - 第一步创建了一个 MySQL 用户组确保 MySQL 服务有独立的用户组管理权限。# - 第二步创建了一个名为 mysql 的用户并将其归属于 mysql 用户组。# - 第三步将 MySQL 安装目录的所有权赋予 mysql 用户和 mysql 用户组# 确保 MySQL 用户对安装目录及其文件拥有必要的读写权限。5安装mysql# 运行 MySQL 数据库初始化脚本# 该命令用于初始化 MySQL 数据库mysql_install_db 是 MySQL 初始化命令XXX/scripts/mysql_install_db \--usermysql \# 指定 MySQL 的运行用户为 mysql--basedir/home/mysql/mysql5.5.56 \# 指定 MySQL 的安装目录通常是 MySQL 的主目录--datadir/home/mysql/mysql5.5.56/data# 指定 MySQL 的数据存储目录数据库文件将存放在此处6mysql额外配置# 1. 修改 MySQL 数据目录的拥有者为 mysql 用户和 mysql 用户组chown-R mysql:mysqldata# 2. 设置 MySQL 配置文件的权限为 644# 644 表示文件所有者有读写权限组用户和其他用户只有读权限chown 644/etc/my.cnf# 3.为 MySQL 的实际工作目录设置权限确保 sock 文件可写chmod 777/home/mysql/mysql5.5.46/data# 4. 将 MySQL 服务脚本复制到系统 init.d 目录# 支持开机自启动功能cp./support-files/mysql.server/etc/rc.d/init.d/mysqld# 5. 为 mysqld 服务脚本添加执行权限# 使该脚本可以被系统执行chmodx/etc/rc.d/init.d/mysqld# 6. 创建 MySQL 命令的软链接避免启动时找不到 mysql 命令# 将 mysql 命令路径链接到系统的 PATH 路径中ln-s/home/mysql/mysql5.5.56/bin/mysql/usr/bin/mysql# 7. 添加 MySQL 服务到系统管理工具 chkconfig# chkconfig 用于管理服务的开机启动项chkconfig--add mysqld# 8. 列出 mysqld 服务的级别状态# 确保 mysqld 服务在指定运行级别如 3 或 5下可以自动启动chkconfig--list mysqld# 9. 打开防火墙的 3306 端口# 3306 是 MySQL 的默认端口用于远程访问 MySQL 数据库firewall-cmd--zonepublic--add-port3306/tcp--permanent# 10. 重新加载防火墙配置使新规则生效firewall-cmd--reload7mysql配置8配置mysql环境变量进入vi /etc/profile配置文件配置环境变量保存后执行source /etc/profile使配置立即生效。export PATH$PATH:/home/mysql/mysql5.5.46/bin9启动mysql并设置root用户密码执行 service mysql start 启动mysql执行mysqladmin –u root –S /var/lib/mysql/mysql.sock password ‘123456’为root用户设置密码10登录mysql进行验证11在mysql下创建hive数据库登录mysql使用下面命令创建数据库Hivecreate database hive12授权远程机器访问hive数据库登录mysql使用下面命令为远程机器使用root用户访问数据库Hive因为 MySQL 服务器的访问控制设置不允许从你的 Hive 服务器主机进行连接需要登录mysql按下面步骤进行授权。使用root用户登录mysql切换到hive数据库。 执行 grant all privileges on hive.* to ‘用户名%’ identified by ‘用户密码’%为替换为自己的hive主机ip或主机名。 执行 flush privileges 刷新权限13上传mysql驱动到hive的bin目录14复制hive的jline2.12.jar到hadoop相应目录把hive的jline2.12.jar复制到hadoop的相应目录替换hadoop的jline-2.11.jar命令如下cd/home/master/hadoop/7.6hadoop2.6.0/share/hadoop/yarn/lib/mvjline-2.11.jar jline-2.11.jar.bakcp/home/master/hive/hive1.2.0/lib/jline-2.12.jar./15修改hive-site.xml基于内嵌模式基础上修改元数据存储方式为mysql就变成了本地模式。configuration property namejavax.jdo.option.ConnectionURL/name valuejdbc:mysql://mysql:3306/hive?useSSLfalseamp;characterEncodingUTF-8/value /property property namejavax.jdo.option.ConnectionDriverName/name valuecom.mysql.jdbc.Driver/value /property property namejavax.jdo.option.ConnectionUserName/name valuemaster/value /property property namejavax.jdo.option.ConnectionPassword/name value123456/value /property /configuration16初始化元数据执行下面命令初始化元数据schematool –initSchema –dbtype mysql-verbose17启动hive执行下hive 命令启动hive4.远程模式1配置hive-site.xmlconfiguration property namejavax.jdo.option.ConnectionURL/name valuejdbc:mysql://mysql:3306/hive?useSSLfalseamp;characterEncodingUTF-8/value /property property namejavax.jdo.option.ConnectionDriverName/name valuecom.mysql.jdbc.Driver/value /property property namejavax.jdo.option.ConnectionUserName/name valuemaster/value /property property namejavax.jdo.option.ConnectionPassword/name value123456/value /property property namehive.server2.thrift.bind.host/name valuehivemaster/value /property property namehive.metastore.uris/name valuethrift://hivemaster:9083/value /property /configuration2初始化元数据执行下面命令初始化元数据schematool –initSchema –dbtype mysql-verbose3启动hive启动hive前执行下面3个任何一个启动metastore服务前台启动 hive –service metastore关闭ctrlc 后台启动 进程挂起关闭jps kill nohup hive –service metastore 前台启动 开启debug日志 hive –service metastore –hiveconf hive.root.loggerDebug,console最后再执行hive启动hive注如有错误欢迎指正留言私信这个超级详细版本希望给大家带来帮助